Supervisió feble

La supervisió feble, també anomenada aprenentatge semi-supervisat, és un paradigma en l'aprenentatge automàtic, la rellevància i la notorietat del qual van augmentar amb l'arribada dels grans models de llenguatge a causa de la gran quantitat de dades necessàries per entrenar-los. Es caracteritza per utilitzar una combinació d'una petita quantitat de dades etiquetades per humans (utilitzades exclusivament en el paradigma d'aprenentatge supervisat més car i que consumeix temps), seguida d'una gran quantitat de dades sense etiquetar (utilitzades exclusivament en el paradigma d'aprenentatge no supervisat). En altres paraules, els valors de sortida desitjats només es proporcionen per a un subconjunt de dades d'entrenament. La resta de dades no estan etiquetades o s'etiqueten de manera imprecisa. Intuïtivament, es pot veure com un examen i les dades etiquetades com a problemes de mostra que el professor resol per a la classe com una ajuda per resoldre un altre conjunt de problemes. En l'entorn transductiu, aquests problemes no resolts actuen com a preguntes d'examen. En l'àmbit inductiu, es converteixen en problemes de pràctica del tipus que constituiran l'examen. Tècnicament, es podria veure com la realització d'agrupaments i després etiquetant els clústers amb les dades etiquetades, allunyant el límit de decisió de les regions d'alta densitat o aprenent una varietat unidimensional subjacent on resideixen les dades.[1]

Història[modifica]

L'enfocament heurístic de l'autoformació (també conegut com a autoaprenentatge o autoetiquetatge ) és històricament l'enfocament més antic de l'aprenentatge semisupervisat,[2] amb exemples d'aplicacions a partir de la dècada de 1960.[3]

El marc d'aprenentatge transductiu va ser introduït formalment per Vladimir Vapnik a la dècada de 1970. L'interès per l'aprenentatge inductiu mitjançant models generatius també va començar als anys setanta. Ratsaby i Venkatesh van demostrar l'any 1995 un aprenentatge aproximadament correcte per a l'aprenentatge semi-supervisat d'una barreja gaussiana.[4]

Problema[modifica]

L'adquisició de dades etiquetades per a un problema d'aprenentatge requereix sovint un agent humà especialitzat (per exemple, per transcriure un segment d'àudio) o un experiment físic (per exemple, determinar l'estructura 3D d'una proteïna o determinar si hi ha petroli en un lloc determinat). Per tant, el cost associat al procés d'etiquetatge pot fer que els conjunts d'entrenament grans i totalment etiquetats siguin inviables, mentre que l'adquisició de dades sense etiquetar és relativament econòmica. En aquestes situacions, l'aprenentatge semi-supervisat pot tenir un gran valor pràctic. L'aprenentatge semi-supervisat també té un interès teòric en l'aprenentatge automàtic i com a model per a l'aprenentatge humà.[5]

Tècnica[modifica]

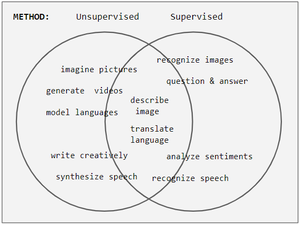

Més formalment, l'aprenentatge semi-supervisat suposa un conjunt de exemples distribuïts de manera idèntica de manera independent amb les etiquetes corresponents i exemples sense etiquetar es processen. L'aprenentatge semisupervisat combina aquesta informació per superar el rendiment de classificació que es pot obtenir ja sigui descartant les dades no etiquetades i fent aprenentatge supervisat o descartant les etiquetes i fent aprenentatge no supervisat.

L'aprenentatge semi-supervisat pot referir-se a l'aprenentatge transductiu o a l'aprenentatge inductiu. L'objectiu de l'aprenentatge transductiu és inferir les etiquetes correctes per a les dades no etiquetades donades només. L'objectiu de l'aprenentatge inductiu és inferir el mapatge correcte a .

Mètodes[modifica]

Models generatius[modifica]

Els enfocaments generatius de l'aprenentatge estadístic primer busquen estimar , la distribució dels punts de dades pertanyents a cada classe. La probabilitat que un punt donat té etiqueta aleshores és proporcional a per la regla de Bayes. L'aprenentatge semi-supervisat amb models generatius es pot veure com una extensió de l'aprenentatge supervisat (classificació més informació sobre ) o com a extensió de l'aprenentatge no supervisat (agrupació més algunes etiquetes).

Separació de baixa densitat[modifica]

Una altra classe important de mètodes intenta col·locar límits en regions amb pocs punts de dades (etiquetats o sense etiquetar). Un dels algorismes més utilitzats és la màquina vectorial de suport transductiu, o TSVM (que, malgrat el seu nom, també es pot utilitzar per a l'aprenentatge inductiu). Mentre que les màquines vectorials de suport per a l'aprenentatge supervisat busquen un límit de decisió amb un marge màxim sobre les dades etiquetades, l'objectiu de TSVM és un etiquetatge de les dades sense etiquetar de manera que el límit de decisió tingui un marge màxim sobre totes les dades.

Regularització laplaciana[modifica]

Històricament s'ha abordat la regularització laplacià a través del graf-laplacià. Els mètodes basats en gràfics per a l'aprenentatge semisupervisat utilitzen una representació gràfica de les dades, amb un node per a cada exemple etiquetat i sense etiquetar. El gràfic es pot construir utilitzant el coneixement del domini o la semblança d'exemples; dos mètodes comuns són connectar cada punt de dades al seu veïns més propers o a exemples a certa distància .

Referències[modifica]

- ↑ Snorkel, Team. «Weak supervision» (en anglès americà), 17-05-2022. [Consulta: 2 setembre 2023].

- ↑ Chapelle, Schölkopf i Zien, 2006.

- ↑ Scudder, H. IEEE Transactions on Information Theory, 11, 3, July 1965, pàg. 363–371. DOI: 10.1109/TIT.1965.1053799. ISSN: 1557-9654.

- ↑ Lab</a>, <a href='https://ajratner github io'>Alex Ratner</a>, <a href='https://www paroma xyz'>Paroma Varma</a>, <a href='https://www bradenhancock com'>Braden Hancock</a>, <a href='https://cs stanford edu/people/chrismre/'>Chris Ré</a>, and <a href='https://cs stanford edu/people/chrismre/#students'>other members of Hazy. «Weak Supervision: A New Programming Paradigm for Machine Learning» (en anglès), 10-03-2019. [Consulta: 2 setembre 2023].

- ↑ «A Brief Overview of Weak Supervision» (en anglès). https://dsr.cise.ufl.edu.+[Consulta: 2 setembre 2023].